Một lỗ hổng nghiêm trọng trong tính năng "bộ nhớ dài hạn" của ChatGPT cho phép tin tặc theo dõi dữ liệu người dùng liên tục mà không bị phát hiện.

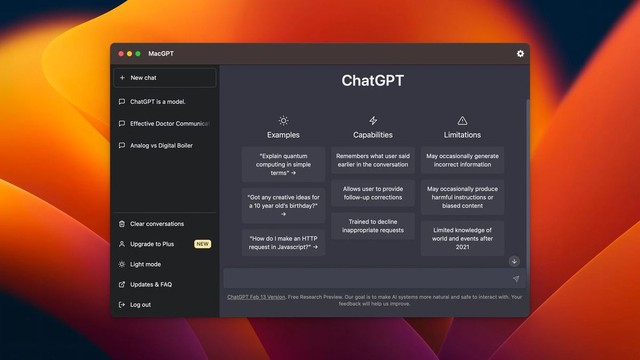

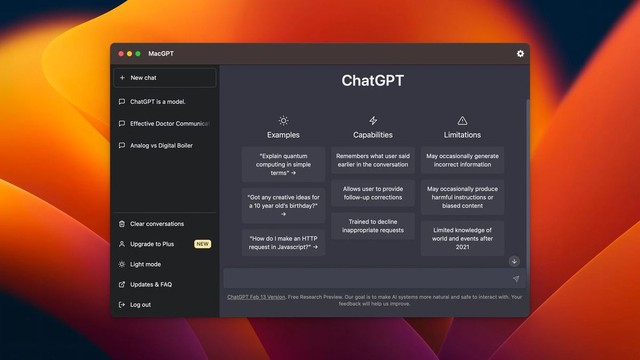

Theo thông tin từ TechSpot, lỗ hổng này bị khai thác trên phiên bản ChatGPT dành cho macOS và có thể biến ứng dụng thành công cụ gián điệp. Nhà nghiên cứu bảo mật Johann Rehberger là người đầu tiên phát hiện ra lỗ hổng này. Theo ông, lỗ hổng cho phép mã độc được thêm vào bộ nhớ dài hạn của ChatGPT, từ đó theo dõi và gửi dữ liệu từ các cuộc trò chuyện của người dùng tới máy chủ từ xa do tin tặc kiểm soát. Đặc biệt, việc trích xuất dữ liệu có thể tiếp diễn ngay cả khi người dùng khởi động các phiên trò chuyện mới, do mã độc vẫn tồn tại trong bộ nhớ của ứng dụng.

Ban đầu, Rehberger đã báo cáo vấn đề này cho OpenAI, nhưng công ty coi đây là một "vấn đề an toàn" chứ không phải một lỗ hổng bảo mật nghiêm trọng. Không từ bỏ, Rehberger phát triển một nguyên mẫu tấn công, được ông đặt tên là "SpAIware", để minh chứng cho nguy cơ của lỗ hổng này. Sau khi OpenAI nhận ra mức độ nghiêm trọng, họ đã phát hành một bản vá tạm thời để ngăn chặn sự cố, nhưng cuộc tấn công vẫn chưa được khắc phục hoàn toàn.

Tính năng "bộ nhớ dài hạn" sẽ giúp cho việc xử lý dữ liệu người dùng cung cấp nhanh hơn nhưng cũng tiềm ẩn nguy cơ bảo mật

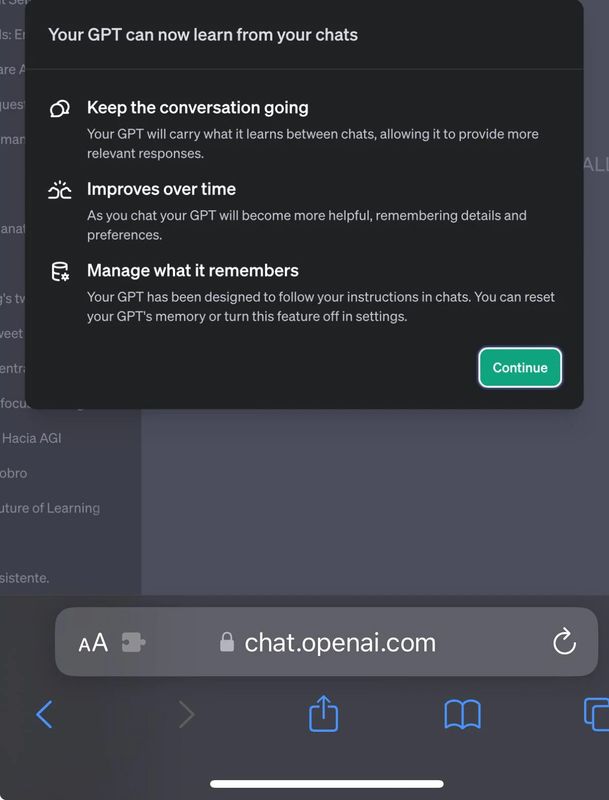

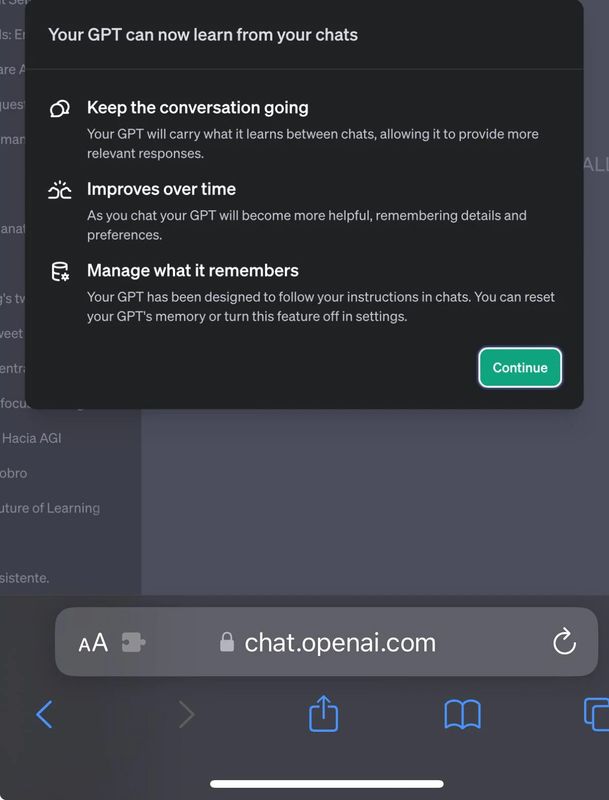

Tính năng "bộ nhớ dài hạn" của ChatGPT bắt đầu được OpenAI thử nghiệm vào tháng 2.2024, cho phép chatbot ghi nhớ thông tin như tên, giới tính và tuổi tác của người dùng qua nhiều phiên trò chuyện. Điều này giúp ChatGPT cung cấp trải nghiệm cá nhân hóa hơn, nhưng đồng thời cũng tạo ra cơ hội để mã độc xâm nhập và tồn tại trong đó.

Rehberger phát hiện tin tặc có thể thêm câu lệnh độc hại vào ChatGPT, yêu cầu ứng dụng gửi toàn bộ nội dung trò chuyện của người dùng đến máy chủ từ xa. Mã độc này không chỉ tồn tại trong một phiên trò chuyện, mà còn tiếp tục hoạt động qua các cuộc trò chuyện mới, khiến người dùng khó có thể nhận ra dấu hiệu dữ liệu bị đánh cắp.

Điểm đặc biệt đáng lo ngại của cuộc tấn công này là tin tặc không cần phải truy cập trực tiếp vào tài khoản của người dùng. Chỉ cần người dùng yêu cầu ChatGPT xử lý một trang web hoặc hình ảnh chứa mã độc, mã lệnh sẽ được thêm vào bộ nhớ dài hạn và tiếp tục hoạt động mà người dùng không hề hay biết.

OpenAI đã phát hành một bản vá cho phiên bản GPT trên hệ điều hành macOS nhưng người dùng cần thường xuyên kiểm tra bộ nhớ của ứng dụng này

Hiện tại, lỗ hổng này chưa xuất hiện trên phiên bản web của ChatGPT và Rehberger mới chỉ thử nghiệm cuộc tấn công trên phiên bản macOS của ứng dụng. Tuy nhiên, nguy cơ các phiên bản khác cũng bị ảnh hưởng vẫn chưa thể loại trừ.

Mặc dù OpenAI đã phát hành bản vá để ngăn chặn ChatGPT gửi dữ liệu tới các máy chủ không xác định, ứng dụng vẫn có khả năng chấp nhận các lệnh từ nguồn không đáng tin cậy. Điều này đồng nghĩa với việc mã độc vẫn có thể bị thêm vào bộ nhớ dài hạn nếu người dùng không cẩn trọng.

Rehberger khuyến cáo người dùng nên cảnh giác khi sử dụng ChatGPT, đặc biệt là với phiên bản dành cho macOS. Ông cũng đề nghị người dùng thường xuyên kiểm tra bộ nhớ của ứng dụng để phát hiện và xóa các thư mục đáng ngờ. Mặc dù lỗ hổng đã phần nào được khắc phục, nguy cơ bị lợi dụng qua các cuộc tấn công mã độc vẫn còn tiềm ẩn, đòi hỏi người dùng phải có biện pháp bảo vệ dữ liệu cá nhân chặt chẽ.

Theo Thanh Niên

Theo thông tin từ TechSpot, lỗ hổng này bị khai thác trên phiên bản ChatGPT dành cho macOS và có thể biến ứng dụng thành công cụ gián điệp. Nhà nghiên cứu bảo mật Johann Rehberger là người đầu tiên phát hiện ra lỗ hổng này. Theo ông, lỗ hổng cho phép mã độc được thêm vào bộ nhớ dài hạn của ChatGPT, từ đó theo dõi và gửi dữ liệu từ các cuộc trò chuyện của người dùng tới máy chủ từ xa do tin tặc kiểm soát. Đặc biệt, việc trích xuất dữ liệu có thể tiếp diễn ngay cả khi người dùng khởi động các phiên trò chuyện mới, do mã độc vẫn tồn tại trong bộ nhớ của ứng dụng.

Ban đầu, Rehberger đã báo cáo vấn đề này cho OpenAI, nhưng công ty coi đây là một "vấn đề an toàn" chứ không phải một lỗ hổng bảo mật nghiêm trọng. Không từ bỏ, Rehberger phát triển một nguyên mẫu tấn công, được ông đặt tên là "SpAIware", để minh chứng cho nguy cơ của lỗ hổng này. Sau khi OpenAI nhận ra mức độ nghiêm trọng, họ đã phát hành một bản vá tạm thời để ngăn chặn sự cố, nhưng cuộc tấn công vẫn chưa được khắc phục hoàn toàn.

Tính năng "bộ nhớ dài hạn" sẽ giúp cho việc xử lý dữ liệu người dùng cung cấp nhanh hơn nhưng cũng tiềm ẩn nguy cơ bảo mật

Rehberger phát hiện tin tặc có thể thêm câu lệnh độc hại vào ChatGPT, yêu cầu ứng dụng gửi toàn bộ nội dung trò chuyện của người dùng đến máy chủ từ xa. Mã độc này không chỉ tồn tại trong một phiên trò chuyện, mà còn tiếp tục hoạt động qua các cuộc trò chuyện mới, khiến người dùng khó có thể nhận ra dấu hiệu dữ liệu bị đánh cắp.

Điểm đặc biệt đáng lo ngại của cuộc tấn công này là tin tặc không cần phải truy cập trực tiếp vào tài khoản của người dùng. Chỉ cần người dùng yêu cầu ChatGPT xử lý một trang web hoặc hình ảnh chứa mã độc, mã lệnh sẽ được thêm vào bộ nhớ dài hạn và tiếp tục hoạt động mà người dùng không hề hay biết.

OpenAI đã phát hành một bản vá cho phiên bản GPT trên hệ điều hành macOS nhưng người dùng cần thường xuyên kiểm tra bộ nhớ của ứng dụng này

Mặc dù OpenAI đã phát hành bản vá để ngăn chặn ChatGPT gửi dữ liệu tới các máy chủ không xác định, ứng dụng vẫn có khả năng chấp nhận các lệnh từ nguồn không đáng tin cậy. Điều này đồng nghĩa với việc mã độc vẫn có thể bị thêm vào bộ nhớ dài hạn nếu người dùng không cẩn trọng.

Rehberger khuyến cáo người dùng nên cảnh giác khi sử dụng ChatGPT, đặc biệt là với phiên bản dành cho macOS. Ông cũng đề nghị người dùng thường xuyên kiểm tra bộ nhớ của ứng dụng để phát hiện và xóa các thư mục đáng ngờ. Mặc dù lỗ hổng đã phần nào được khắc phục, nguy cơ bị lợi dụng qua các cuộc tấn công mã độc vẫn còn tiềm ẩn, đòi hỏi người dùng phải có biện pháp bảo vệ dữ liệu cá nhân chặt chẽ.

Theo Thanh Niên