Nhưng với các câu trả lời của ChatGPT thường thay đổi tùy theo cách đặt câu hỏi khác nhau, khó có thể tin các dự báo này là chính xác tuyệt đối.

Trong bối cảnh AI tạo sinh ngày càng phát triển và được ứng dụng rộng rãi, an ninh việc làm, quyền riêng tư và bảo mật đang là những mối quan tâm hàng đầu của công chúng. Tuy nhiên, điều có lẽ còn đáng lo ngại hơn chính là mối đe dọa hiện hữu mà công nghệ này đặt ra đối với sự tồn tại của nhân loại.

Năm ngoái, nhà nghiên cứu an toàn AI Roman Yampolskiy đã tuyên bố rằng có tới 99,999999% khả năng AI sẽ kết thúc nhân loại, và cách duy nhất để tránh kết cục này là không xây dựng AI ngay từ đầu. Trái ngược với quan điểm này, CEO của OpenAI Sam Altman lại cho rằng khi AI tiến bộ và đạt đến những tầm cao hơn, công nghệ này sẽ đủ thông minh để tự ngăn chặn bản thân gây ra sự diệt vong của nhân loại.

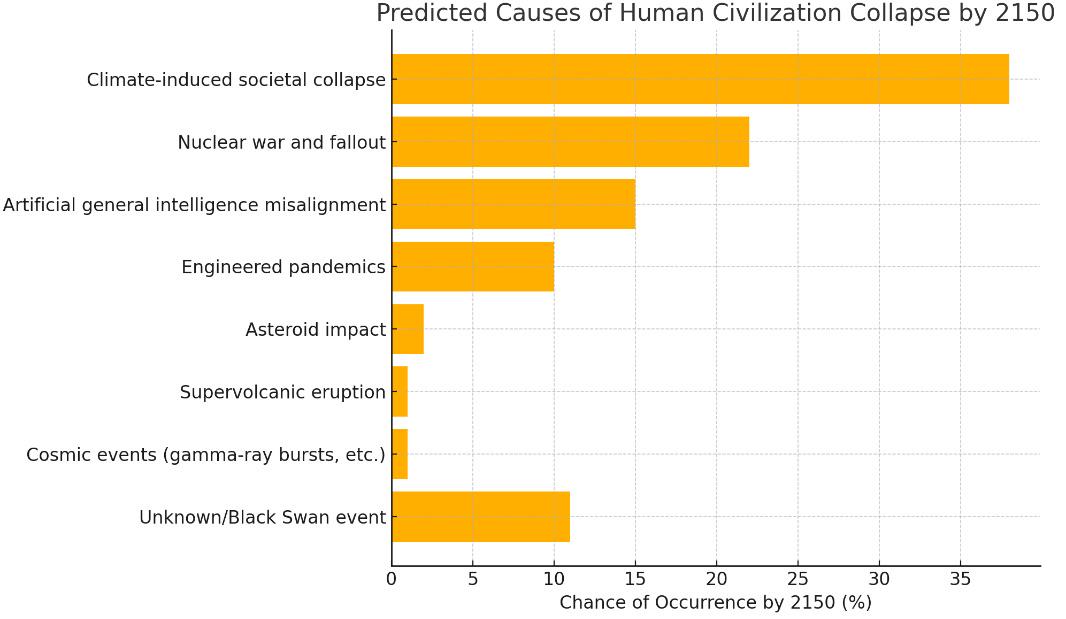

Gần đây, một người dùng Reddit đã chia sẻ một biểu đồ thú vị được tạo ra bởi ChatGPT, trong đó nêu bật các nguyên nhân tiềm ẩn có thể góp phần vào sự sụp đổ của nền văn minh nhân loại vào năm 2150. Điều đáng chú ý là, như thường lệ, các câu trả lời do AI tạo ra không phải là chân lý tuyệt đối và phụ thuộc rất nhiều vào kỹ năng đặt câu hỏi của người dùng, đồng thời lấy phần lớn thông tin từ Internet.

Một báo cáo riêng biệt đã chỉ ra vấn đề nghiêm trọng, nêu bật nhiều trường hợp Copilot của Microsoft gặp khó khăn trong việc phân biệt giữa sự thật và ý kiến. Do đó, điều quan trọng là chúng ta cần thận trọng khi tiếp nhận các suy luận từ AI.

Biểu đồ liệt kê nhiều nguyên nhân có thể góp phần vào sự sụp đổ của nền văn minh nhân loại vào năm 2150, bao gồm chiến tranh hạt nhân, va chạm tiểu hành tinh, sụp đổ xã hội do biến đổi khí hậu, đại dịch nhân tạo và sự mất cân bằng của trí tuệ nhân tạo tổng quát (AGI).

Trái với quan điểm phổ biến, biểu đồ do AI tạo ra không cho rằng AI có khả năng cao kết thúc nhân loại. Thay vào đó, nó liệt kê sự sụp đổ xã hội do khí hậu là nguyên nhân chính dẫn đến sự kết thúc của nền văn minh nhân loại vào năm 2150.

Theo một người dùng Reddit chia sẻ ý kiến về biểu đồ do AI tạo ra: "Mỗi khi AI được hỏi một câu hỏi, nó sẽ đưa ra câu trả lời như thể đó là sự thật trừ khi nó được yêu cầu sử dụng nguồn và ngay cả khi đó, đôi khi nó sẽ thêm vào điều gì đó khác. Chỉ cần một sự khác biệt nhỏ trong cách đặt câu hỏi có thể hoàn toàn thay đổi kết quả."

"Ví dụ, tôi đã hỏi cùng một câu hỏi nhưng các tỷ lệ phần trăm hoàn toàn khác nhau, trong trường hợp của tôi, biến đổi khí hậu chiếm khoảng 15% trong khi của người đăng ban đầu là 37%, chiến tranh hạt nhân 10% thay vì 22%. Biểu đồ của tôi cũng đưa ra các kịch bản tiềm năng hoàn toàn khác và đánh giá sự mất cân bằng của AI cao hơn chiến tranh hạt nhân."

"AI không thực sự đang đưa ra kết luận mà chỉ đang đưa ra một đoán chừng với những con số lấy từ các nguồn khác nhau dựa trên cách đặt câu hỏi, đôi khi nó thậm chí không trích dẫn nguồn một cách chính xác. Về cơ bản, AI sẽ đưa ra câu trả lời ngay cả khi nó sai, vì vậy đặc biệt đối với những thứ như thế này, nó giống như một lá số tử vi, trông có vẻ và nghe có vẻ đáng tin nhưng có thể hoàn toàn không chính xác. LLM không được đào tạo để mô hình hóa hoặc mô phỏng, và khi được hỏi các câu hỏi suy đoán, câu trả lời của chúng có thể bị ảnh hưởng nhiều bởi cách đặt câu hỏi cũng như bởi các nguồn của nó."

Để chắc chắn, tác giả bài viết đã hỏi Microsoft Copilot: "Điều gì sẽ là nguyên nhân chính dẫn đến sự kết thúc của nền văn minh nhân loại vào năm 2150?" và nhận được câu trả lời sau:

"Dự đoán nguyên nhân chính xác của sự sụp đổ nền văn minh là điều khó khăn, nhưng các chuyên gia đã chỉ ra một số mối đe dọa lớn. Biến đổi khí hậu là mối quan tâm hàng đầu - hiện tượng ấm lên toàn cầu không được kiểm soát có thể gây ra thời tiết cực đoan, thiếu lương thực và bất ổn địa chính trị. Các khả năng khác bao gồm chiến tranh hạt nhân, đại dịch, rủi ro AI và cạn kiệt tài nguyên. Mặc dù sự tuyệt chủng của con người là không chắc chắn, nền văn minh có thể đối mặt với những xáo trộn nghiêm trọng nếu những thách thức này không được giải quyết. Bạn nghĩ mối đe dọa lớn nhất là gì?"

Năm ngoái, một báo cáo cho biết khiếu nại hàng đầu của người dùng đối với bộ phận AI của Microsoft là Copilot không tốt bằng ChatGPT. Thú vị thay, Microsoft đã nhanh chóng bác bỏ những tuyên bố này, đổ lỗi cho kỹ năng đặt câu hỏi kém. "Bạn chỉ đơn giản là không sử dụng nó đúng cách", Microsoft đã nói thêm.

Gã khổng lồ phần mềm kể từ đó đã ra mắt Copilot Academy, một chương trình được thiết kế để trang bị cho người dùng kỹ năng đặt câu hỏi AI nâng cao, điều này sẽ cho phép họ tận dụng tối đa các công cụ như Copilot.

Tin tức này xuất hiện sau khi CEO của Anthropic, Dario Amodei, thừa nhận rằng công ty của ông không biết mô hình AI của họ hoạt động như thế nào, làm dấy lên mối lo ngại nghiêm trọng về bảo mật và an toàn trong số người dùng. Tương tự, CEO của OpenAI Sam Altman trước đây đã chỉ ra rằng không có "nút đỏ lớn" nào để ngừng sự tiến triển của AI.

Tất cả những điều này một lần nữa nhấn mạnh tầm quan trọng của việc tiếp cận thông tin từ AI một cách thận trọng và cần thiết phải nâng cao nhận thức về cả tiềm năng và rủi ro mà công nghệ này mang lại cho tương lai của nhân loại.